Борис Кобринский: «Рефлексия — вещь полезная! Искусственный интеллект не заменитель вашего разума»

С председателем Научного совета Российской ассоциации искусственного интеллекта, доктором медицинских наук, профессором Борисом Аркадьевичем Кобринским можно говорить часами, ведь он – кладезь знаний и профессионального опыта. В сфере ИИ у нашего собеседника разные области интересов, среди них – инженерия знаний, нечеткие логики и, конечно, проблемы прикладных систем в медицине, которыми он занимается в течение 40 с лишним лет.

Сейчас Борис Аркадьевич, обладатель медали «За заслуги перед отечественным здравоохранением», заведует отделом систем интеллектуальной поддержки принятия решений Института проблем искусственного интеллекта Федерального исследовательского центра «Информатика и управление» РАН. А еще является профессором кафедры медицинской кибернетики и информатики Российского национального исследовательского медицинского университета им. Н.И. Пирогова. О путанице понятий, необъяснимости решений, рефлексивности и «горячих точках» в сфере искусственного интеллекта, читайте в интервью.

— Борис Аркадьевич, расскажите об ассоциации. Чем она занимается?

— Ассоциация искусственного интеллекта была создана в 1989 году по инициативе нашего выдающегося ученого — Дмитрия Александровича Поспелова. Он одним из первых начинал исследования в этой сфере. Наша основная миссия – это развитие и продвижение идей в области искусственного интеллекта, организация взаимодействия ученых, специалистов – как разработчиков, так и пользователей ИИ-систем.

Кроме того, за 30 с лишним лет работы ассоциации нашими экспертами сформированы четкие представления о том, что может и чего не может искусственный интеллект. Должен сказать, что бытующее сегодня понимание искусственного интеллекта не совсем соответствует термину artificial intelligence, который был предложен Джоном Маккарти в 1956 году. Правильный перевод означает «умение рассуждать разумно».

То есть это системы, которые на основе знаний, а не данных, умеют рассуждать разумно. Речь не о полноценном интеллекте, а об имитации человеческого способа принятия решений. Существуют многочисленные модели и методы искусственного интеллекта, в частности инженерия знаний, нечеткая логика, логико-лингвистические модели, семантические сети, а наряду с ними технологии: машинное обучение, нейросети и их наиболее интересное решение – глубокое обучение. И мы стремимся доносить до широкой общественности правильные представления, помогать в создании ИИ-систем, отмечать наиболее ценные достижения. В этих целях работает научный семинар, регулярно проводятся Национальные конференции по искусственному интеллекту с международным участием.

— Среди тем научно-практических конференций, которые проводит Ассоциация: беспилотные транспортные средства, инструменты ИИ для решения социальных и экономических проблем, мягкие вычисления, технологии проектирования интеллектуальных систем… Есть ли какие-то общие задачи и проблемы, с которыми сталкиваются ученые и разработчики систем искусственного интеллекта, независимо от своей специализации?

— Сегодня все чаще говорят о необходимости объяснимого искусственного интеллекта, потому что ни machine learning, ни нейросети не объясняют решения, к которым приходят. Нейросети, например, – это мощная вычислительная система, обрабатывающая те веса, коэффициенты, оценки, которые вводятся в нее. Коэффициенты уточняются и изменяются. Это очень важный момент – интерпретация перенастройки весов. Но когда выдается гипотеза с учетом изменения коэффициента, пользователю совершенно непонятно – как и почему компьютерная интеллектуальная система к ней пришла. А если речь об атомной станции, человек должен что – нажать после этого кнопку?

Вот в чем сегодняшняя проблема. На нее, к слову, обращали внимание и представители Минобороны на форуме «Армия-2021», в котором ассоциация тоже активно участвовала.

— Объяснимость гипотез ИИ крайне важна не только в ядерной энергетике или военно-промышленном комплексе, но и в медицине, где цена ошибки очень высокая?

— Да, сегодня речь идет о необходимости объяснений именно для критических приложений – тех, которые используются на любых техногенно опасных объектах, в авиа- и космической отраслях и так далее. Конечно, и в медицине – особенно реанимации. Там должны быть очень внятные и быстрые объяснения.

Метод машинного обучения ведь может извлекать знания, которые на самом деле нам не нужны. Ответы системы на вопросы «Как?» и «Почему?» в том числе помогут экспертам оценить значимость этих новых фактов. Они нас куда-то продвинут?

Между прочим, в первой медицинской системе Mycin, созданной в 1976 году, некое объяснение было, как и в первых отечественных ИИ-системах, и в некоторых современных.

— Сейчас в центре внимания и этические аспекты применения ИИ-систем. На днях как раз был представлен и подписан рядом крупных организаций первый в России кодекс этики в сфере искусственного интеллекта…

— Ассоциация, кстати, участвовала в обсуждении проекта этого документа в Аналитическом центре при Правительстве РФ – нас пригласили поделиться своими соображениями. Мы предложили скорректировать ряд положений, а от некоторых отказаться.

В этом кодексе прописаны принципы, которыми должны руководствоваться люди и компании при разработке и эксплуатации прикладных систем. Но могут появиться настолько продвинутые интеллектуальные роботы, что понадобится и для них устанавливать этические нормы.

Есть целая область эмоций в искусственном интеллекте. Вот вы мне сейчас улыбаетесь. А если вам навстречу идет робот с угрожающей маской на лице? Может быть, он шутит. Но вы-то не знаете! Это же будет не игра в мобильном устройстве, а предмет движущийся и достаточно тяжелый.

— Действительно, в такой ситуации будет не до смеха! К слову, о кодексе. В нем компаниям рекомендуется сообщать пользователям о взаимодействии с системами искусственного интеллекта. Но, как ранее на одной из конференций отметил представитель сервиса по разработке роботов-операторов для урегулирования банковских задолженностей, эффективность таких коллекторов высокая во многом благодаря тому, что клиенты зачастую не понимают, что им звонит робот. Вы здесь на стороне бизнеса или человека?

— Когда вы мне звоните – представляетесь. И робот должен. В медицинских организациях тоже сейчас работают роботы. Не всегда удачно. Недавно я звонил в одну очень хорошую медицинскую коммерческую структуру: хотел записаться к врачу, заведующему отделением. А робот мне ответил, что такого сотрудника у них нет. Программный дефект. Естественно, я положил трубку и потом связался с «живым» оператором. Но если бы я не осознавал, что мне отказал робот, то мог вступить с собеседником в объяснение. Не нужно ставить человека в положение, когда он не понимает, с кем взаимодействует.

— Что ж, посмотрим, будут ли компании следовать этому принципу. Все же кодекс носит рекомендательный характер…

— Вообще, кодексов этики в сфере искусственного интеллекта очень много – во всем мире принято более 100 таких документов. И очень трудный момент – мы его тоже обсуждали на стадии проекта – это разграничение понятий нормативных и этических. Есть нормы, несоблюдение которых может привести к негативным для человека последствиям, и это должно быть административно или уголовно наказуемо. Не надо делать такие нормы этическими, потому что тогда мы заходим в тупик. Грань тонкая между этикой и юридически значимыми моментами, которые надо прописывать.

— Сейчас активно разрабатываются медицинские инструменты на основе ИИ, которые помогают в диагностике заболеваний, визуализации, прогнозировании, подборе лекарств-кандидатов… Какие области применения систем искусственного интеллекта в здравоохранении вы, как доктор медицинских наук, считаете наиболее перспективными? Какие тренды отмечаете?

— В последние несколько лет стали активнее создаваться системы здоровьесбережения на базе искусственного интеллекта. Такую систему мы сделали, например, в Федеральном исследовательском центре «Информатика и управление» РАН, где я заведую отделом. Она оценивает риски инфаркта, инсульта, артериальной гипертензии и депрессии. Помимо этого, инструмент дает человеку рекомендации. Разумеется, под контролем врача.

Другое мощное направление, которое сегодня бурно развивается, связано с технологиями deep learning – в основном нейросетями, которые применяются в области компьютерного зрения для анализа медицинских изображений (радиологических, гистологических и так далее).

И здесь нужно двигаться в сторону гибридных систем – тех, которые объединяют медицинские изображения с лингвистической и вербальной информацией, полученной из литературы или от специалистов. То есть должны быть лингво-образные базы знаний. Они позволят компьютерным системам учитывать при выдвижении гипотез и видеть на экране, к примеру, не только радиологическое изображение, но и контент, который относится к конкретному пациенту. Если мы его не учитываем, то рискуем получить искаженную картину. Хорошо, если здорового назвали больным, это выяснится в результате проверки. А если ошиблись в другую сторону?

На самом деле в России сейчас не так много медицинских систем искусственного интеллекта – из-за недостаточного финансирования. И чтобы они нашли широкое применение, нужно обращать внимание на «горячие точки», о которых я говорил, в частности, в своем пленарном докладе на XIX Национальной конференции по искусственному интеллекту.

— И что это за «горячие точки»?

— Одна из них в том, что создаются системы отдельно для диагностики, отдельно для прогноза, отдельно для чего-то еще. А человек идет по цепочке: сначала ему нужно поставить диагноз, назначить лечение, сделать прогноз течения заболевания, возможных осложнений, которые в том числе могут вызвать назначаемые лекарства. И нам нужны не отдельные системы, а сквозные. Врач не может постоянно из одной системы переходить в другую со своим интерфейсом.

Вместе с тем электронная медицинская карта сегодня начинает наполняться данными. Раньше все интеллектуальные системы работали автономно, задавая вопросы врачу и получая от него информацию. Сегодня мы должны отказаться от повторного ввода. Это противоречит принципу информатики: однократный ввод и многократное использование информации. Но тогда надо организовать систему извлечения данных из медицинских карт. А большая их часть не формализована. Данные вносятся очень по-разному, с большим количеством ошибок.

— А насколько эффективны роботы, применяемые в медицине? При операциях используется робототехника, для помощи врачам уже создали робота-медсестру!

— Сегодня часто путают понятия: роботы и манипуляторы. Например, хирургический робот да Винчи, в сущности, не робот, тем более не интеллектуальный. Это очень хороший манипулятор, который позволяет хирургу проводить операцию и даже снимает дрожание его рук. Робот – это нечто автономное. А манипулятор – это то, чем управляет человек.

Интеллектуальный робот умеет реагировать на что-то. Приведу в пример разработку профессора Виктора Константиновича Финна, известного специалиста в области искусственного интеллекта. Пример почти игрушечный, но понятный. Маленький робот выходит из дома и гуляет, пока светят солнце или фонари. Когда становится темно – для него это сигнал о том, что надо идти домой. Так, любой интеллектуальный робот должен перерабатывать какую-то информацию, что-то различать. То есть воспринимать сигналы, анализировать ситуацию, принимать решение и на основе этого действовать.

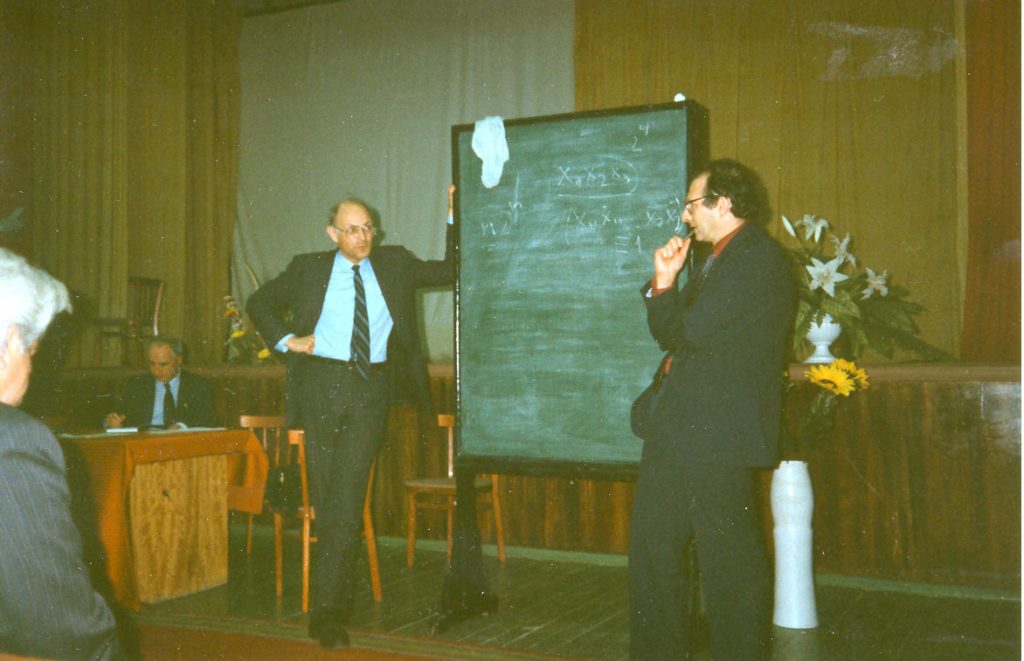

Дискуссия Б. А. Кобринского и В. К. Финна на Национальной конференции по искусственному интеллекту с международным участием (КИИ) в 2000 году

Многочисленные медицинские роботы, которые сейчас появляются, могут передвигаться, раздавать лекарства. Наконец, роботы телеприсутствия – приходят в палату, наводят камеру на больного. Но это неинтеллектуальные роботы. Конечно, есть и другие, но их не так много.

— К слову, востребованность телемедицины возросла на фоне пандемии COVID-19. Пусть роботы телеприсутствия неинтеллектуальные. Но есть же технологии искусственного интеллекта, которые помогают в этом сегменте здравоохранения?

— В первую очередь телемедицина – это контакт между врачом и пациентом, который хочет получить дополнительную информацию. Можем ли мы встроить здесь искусственный интеллект? Пока у нас интеллекта в этом нет. Однако искусственный интеллект может обрабатывать заявку, вести переписку, выявлять несоответствия в данных, приводить в удобный для консультанта порядок лабораторные анализы и так далее, что позволяет экономить время врача-консультанта и пациента. Эти задачи решают системы обработки естественного языка, это большой пласт искусственного интеллекта сегодня.

— Борис Аркадьевич, при диагностике, да и в целом при принятии медицинских решений, как сказано в ваших работах, играют роль особенности мышления экспертов: интуиция, уверенность в своих знаниях и рефлексивность в отношении формирующихся гипотез. Возможно, искусственный интеллект, лишенный интуиции и сомнений, устранит риски, связанные с этими факторами? Или лучше оставить за человеком возможность использовать «профессиональное чутье»?

— Вы знаете, Наталья, тут две стороны. Мы вторгаемся в эту область при работе с экспертом, когда создаем базу знаний для принятия решений: пытаемся ту интуицию, которой обладает высококвалифицированный специалист извлечь, вместе с тем избавиться от некой пристрастности в каких-то вопросах или жесткой приобщенности к какой-то научной школе. Опыт мой и моих коллег показал, что вскрывать эти интуитивные моменты удается, когда для извлечения знаний мы выстраиваем работу с группой экспертов, используя методы интервью или мозгового штурма: один замечает то, чего не сказал другой, для которого что-то само собой разумеющееся. Когнитолог, инженер по знаниям, получает эту информацию – и мы ее включаем в базу знаний.

Рефлексивность эксперта имитируем тем, что система осуществляет самопроверку – достаточно ли этих знаний либо надо расширить область знаний и данных, а потом ее обратно схлопнуть до необходимого.

У врача, который пользуется системой, тоже есть и интуиция, и рефлексия, и школа. И ему мы стараемся тоже давать возможность свое представление вкладывать в интерактивном общении с интеллектуальной системой. Например, за счет изменения веса какого-то признака. Скажем, в случае конкретного пациента, по мнению врача, нарушение походки очень важно, поэтому он меняет в системе вес этого признака с 30% до 70%. И видит соответствующую гипотезу. А если понимает, что интуиция его подвела, то возвращается к исходному весу.

Пока только в единичных системах есть такая опция. Но эта игра с признаками для пользователя – возможность личного участия. Специалисту важно понимать, что в итоге получается человеко-машинное решение. Если, конечно, речь идет об автоматизированных системах, которые предусматривают участие человека. Если они автоматические – без него, как автопилот, то мы должны эту интуицию, рефлексию в кавычках приложить к данной системе, предусмотрев проверку гипотезы путем привлечения дополнительных знаний и данных.

Б. А. Кобринский (справа) на международном конгрессе «Информационные технологии в медицине», 2010 год

— На ваш взгляд, чего нам ждать в ближайшее время в сфере искусственного интеллекта?

— Думаю, уже через несколько лет мы увидим охлаждение интереса к искусственному интеллекту. Развеется радужное представление о том, что он сделает нашу жизнь прекрасной. Потому что это достаточно сложно. Пока мы быстро реализуем только простые ИИ-решения. Придет понимание того, что может дать искусственный интеллект и что для этого требуется. Все мы начнем более здраво к нему относиться.

Реализация концепций умного города, умного дома пойдет быстрее в сравнении с развитием других областей применения ИИ. Хотя, без сомнения, в промышленности, обороне искусственный интеллект будет продвигаться достаточно серьезно.

Говорящие роботы станут более разумными. И гуманоидоподобными. Хотя разум все-таки более важный атрибут.

— Как бы вы описали идеальную модель взаимодействия человека и искусственного интеллекта?

— Робот может убирать в квартире, ходить за покупками, отвечать по телефону – это и есть взаимодействие. Если искусственный интеллект не робот, то он все равно помощник. В медицине такие системы любят называть консультантами. Я предпочитаю термин ассистенты. Консультант – выше того, кто к нему обращается. Ассистент – тот, кто помогает.

Люди делятся на три категории. К первой относятся те, кто привержен ИИ-системам так, что не сомневается в них, считает, что математика превыше всего. Другая крайность – полностью отказываться от их применения. И большая прослойка между этими категориями – те, кто ведет себя более-менее осторожно, соотносит рекомендации искусственного интеллекта со своими представлениями.

Надо учиться воспринимать ассистирование систем и осознавать – в отношении каких систем следует быть особенно осмотрительным. Это трудный момент.

— Да, критическое мышление никто не отменял, нужно все подвергать сомнению.

— Совершенно верно! Когда-то у нас говорили «рефлексирующий интеллигент». Но рефлексия – вещь полезная! Это ведь, по сути, самопроверка.

Однажды искусственный интеллект превратится в неотъемлемую часть экзоокружения человека. Надо понимать, что это помощник, но не заменитель вашего разума.

Беседовала Наталья Травова

Фото: из личного архива Б. А. Кобринского